| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | 2 | 3 | 4 | 5 | 6 | 7 |

| 8 | 9 | 10 | 11 | 12 | 13 | 14 |

| 15 | 16 | 17 | 18 | 19 | 20 | 21 |

| 22 | 23 | 24 | 25 | 26 | 27 | 28 |

- hqs-algorithm

- unconditional ddpm

- ddpm

- ddrm

- daod

- ddim

- image restoration

- object detection

- linear inverse problem

- Ai

- semi-supervied learning

- f2dnet

- neighboring pixel relationships

- IR

- ML

- conditional diffusion

- diffusion

- fourmer

- face forgery detection

- pedestrian detection

- Triplet

- ccdf

- diffpir

- stochastic contraction theory

- facenet

- focal detection network

- unconditional generative models

- ilvr

- ssda-yolo

- deepfake detection

- Today

- Total

Stand on the shoulders of giants

[paper review] ILVR: Conditioning Method for Denoising Diffusion Probabilistic Models 본문

[paper review] ILVR: Conditioning Method for Denoising Diffusion Probabilistic Models

finallyupper 2024. 7. 3. 14:16Introduction

기존 DDPM은 같은 initial state에서 시작하더라도 비일관된 high-level semantics를 기반으로 stochastic하게 이미지를 생성하기때문에 control하기가 어렵다.

Learning-free method이자 generation process에서 각 transition이 reference image를 이용해서 refine되는 모델을 구상하였다. Reference image를 활용해서 coarse ~ fine information 범주로 semantics를 sharing할 수 있도록 하였다.

Contributions

- Generative process의 각 잠재 변수를 주어진 reference image의 것으로 matching함으로써 refine한다.

- User controllabilty를 가진다.

- Multi-domain image translation 등 다양한 이미지 생성 task들에서 사용가능한 unconditional DDPM을 활용한다.

Background

DDPM은 unconditional image generation을 하는 생성 모델로, Markov Chain을 통해 점진적으로 노이즈를 더하고, isotopic Gaussian에서 reverse process를 통해 x0를 approximate하는 모델이라고 요약할 수 있다.

이때 epsilon theta의 neural network를 통해서 denoising process에서 빼줄 noise를 예측함. (이때 input과 output의 dimension이 동일하도록 유지시킴)

Methods

본 논문에서는 Unconditional DDPM을 control할 수 있는 방법론을 제안한다. (conditional DDPM ❌)

Goal = 주어지는 reference image와 high-level semantics를 share할 수 있도록 image를 generate하는 모델을 구축하자.

⇒ Conditional distribution (condition c):

이때 주요한 점은 condition c를 처리할때 추가적인 학습이나 모델이 필요하지 않다.

$\phi_N(.)$ : linear low-pass filtering operation

y: reference image

x0 : generated image

이라고 할때

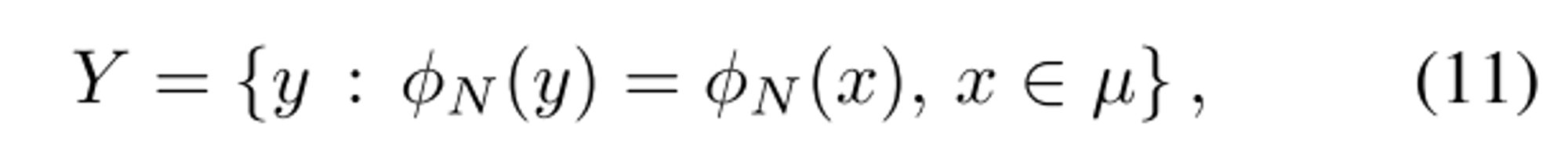

condition c는 x0의 downsampled iamge 와 y의 downsampled가 동일하도록 한다.

> 유도

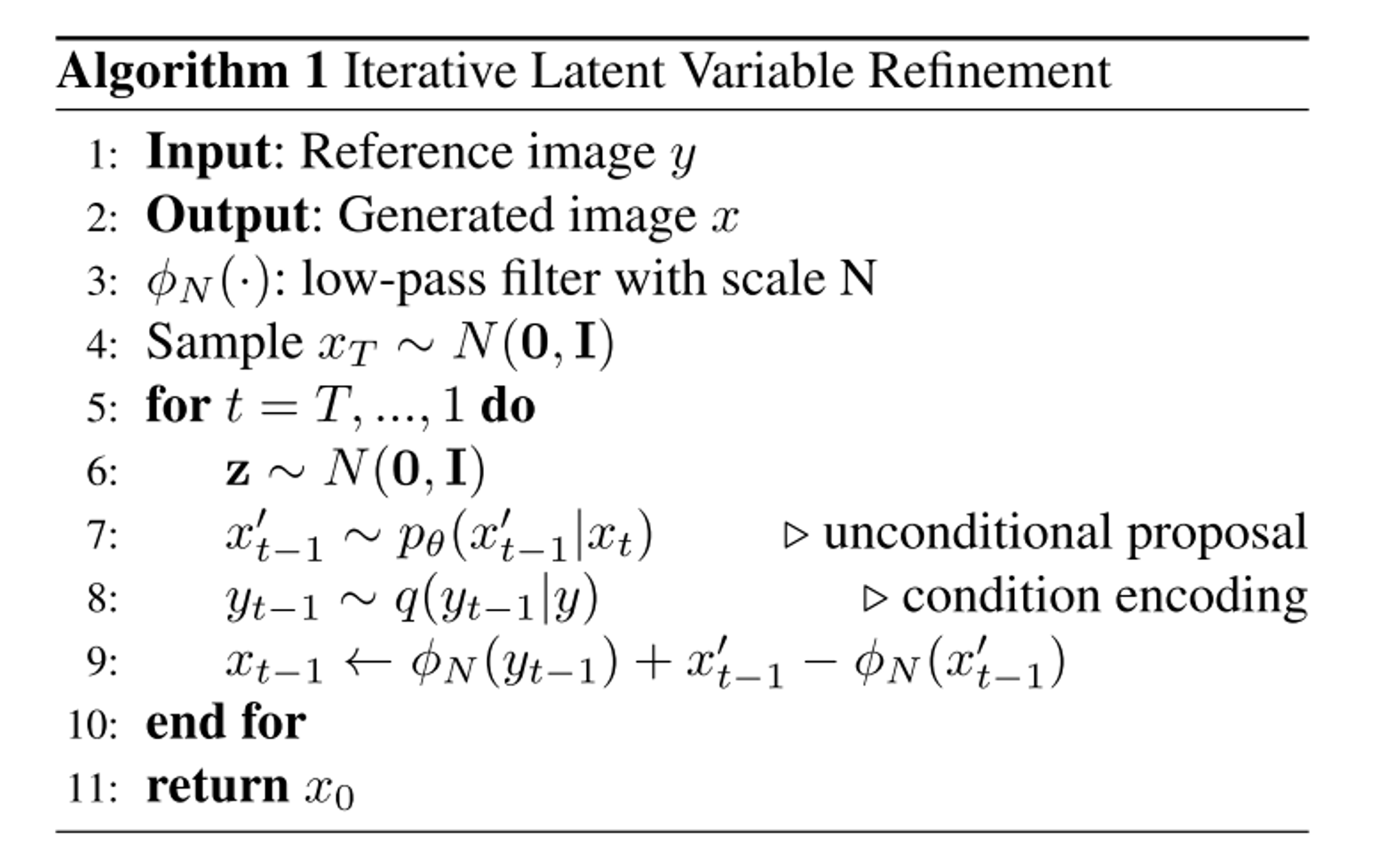

알고리즘

- DDPM을 이용해 x_t로부터 unconditional proposal distribution x_t-1’을 구한다.

- operation phi는 차원을 유지시켜주기때문에 phi(x_t-1’)를 phi(y_t-1)과 matching해서 proposal distribution을 개선한다.

Semantic similarity to the reference를 결정하는 2가지 factors*

1) Reference selection

학습된 data distribution의 low-resolution space와 같아지기만 하면 reference image가 될 수 있다.

이때 학습된 data domains이외에도 unseen data domains에서도 가능하다.

2) User Controllability

[2-1] downsampling factor N → Coarse control

mu는 unconditional DDPM이 generate할 수 있는 이미지들의 집합. N은 downsampling factor의 갯수를 의미하는데,

N이 클수록 reference의 coarse feature들을 share

N이 작을수록 finer feature들을 share.

⇒ 즉 Downsampling factors를 통해서 reference image와 생성할 이미지의 perceptual similarity를 조절할 수 있다.

[2-2] conditioning step range [b, a] → Finer control

Downsampling factors가 coarse feature들을 바꾼다면, conditioning range를 조정하면 fine-grained influence가 있다는 점에서 차이가 있다.

Experiements and Applications

Qualitative Results on User Controllability

: Downsampling factor수와 Range범위를 조정해보았을 때,

- N=8은 fine details만 reference와 달랐고, N=64일때는 reference와 color scheme과 같은 coarse features만 공유했음.

- Range가 좁을 수록 더 broader한 subset으로부터 sampling하는 것이 가능했음.

- *share coarse features= reference 이미지에서 color scheme과 같은 coarse 정보만을 가져와서 (unconditional DDPM)이 이미지를 생성한다.

Multi-Domain Image Translation

: 기존 image translation 모델들의 경우, 학습한 domain-domain translation에 대해서만 동작했었는데

본 모델의 경우 target domain에 대해서만 학습해두면, reference image를 입력받아서 동일하게 image translation task를 수행할 수가 있다.

Paint-to-Image

: Unnatural paintings를 photo-realistic images로 변환해보았고 이때 N=64로 설정해 실험한 결과 주어진 paintings는 learned dataset과 coarse features를 share했음.

Editing with Scribbles

: Valid set의 reference image들에 scribbles를 추가해서 실험함 (N=8)

Quantitative Evaluation

: FID, LPIPS로 평가하였을때 unconditional model의 generation quality를 해치지 않았음을 확인함 (scores 확인)

Conclusions

Unconditional DDPM의 generation process를 conditioning하는 learning-free method를 제시함. 단일 unconditional DDPM이 추가적인 학습이나 모델 없이 다양한 task들에서 사용될 수 있음을 보였다.